Un studiu recent publicat pe arXiv de o echipă de cercetători de la MATS , ETH Zürich și Anthropic sub titlul Large-Scale Online Deanonymization with LLMs arată că modelele LLM moderne pot afla identitatea persoanelor din spatele conturilor online anonime la o scară și cu o acuratețe care depășește cu mult tehnicile anterioare.

În loc să se folosească de seturi de date structurate sau de capacități special introduse și supravegheate de om – așa cum s-a întâmplat la atacurile cibernetice anterioare asupra bazelor de date Netflix, de exemplu – sistemele actuale lucrează direct pe textul nerafinat, nestructurat.

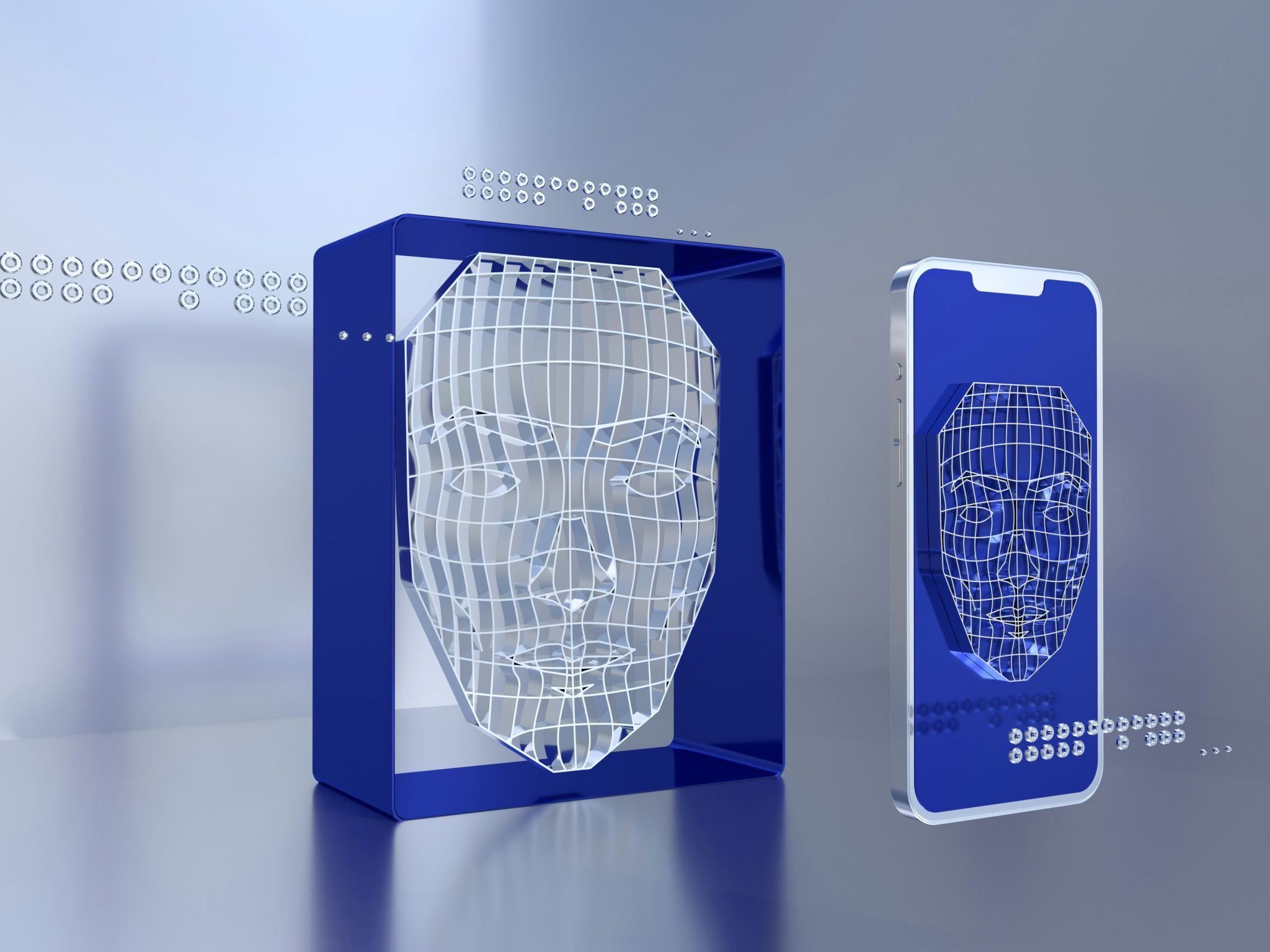

IA poate acum să identifice autorul prin analiza postărilor, a comentariilor sau transcriptului interviurilor date oral sub anonimat, folosindu-se de diverși indici semantici care ar putea semnala identitatea.

După ce face o „listă scurtă” a potențialilor suspecți, robotul – ca orice detectiv – continuă verificările și ajunge, prin eliminare, la identitatea utilizatorului.

În cadrul testelor, modelele au identificat persoanele din spatele unor conturi LinkedIn sau Reddit care postau sub pseudonim pe mai multe platforme cu o precizie de între 68 și 90%.

Dincolo de teama este că aceste performanțe vor fi folosite de hackeri, studiul subliniază că „obscuritatea practică” – ideea că, dacă utilizatorul folosește pseudonime diferite pe diferite platforme, identitatea sa va rămâne ascunsă – nu mai poate fi o soluție. Roboții pot descoperi identitatea utilizatorului după continuitatea pseudonimelor, după stilul de scriere, după particularitățile intereselor pe care le manifestă.

Altfel spus, păstrarea anonimatului online este o iluzie.

Sursa: ZeroHedge